Apple Vision Pro

One more thing…

噂は本当だったのですね。

AppleのAR/VRヘッドセット。

私の記憶する限りでは、2017年頃より開発の噂や、

関連企業の買収/特許申請のニュースが流れていて、

いつ出るか/本当に出すのかの話がずっと続いていた約5年でした。

Appleの発表説明で使用される言葉の中で、

ARやVRという言葉よりも、空間コンピューティング(Spatial Compututing)という

言葉が使用されているのが印象的でした。

先行するプロダクトとは違い、自分たちの考える世界感や存在意義を言葉に詰め込んで、

“新しい体験や生活を社会に提示していくんだ”意志が感じられました。

Appleの参入により市場の活性化や他社への影響は間違いなくあるでしょう。

今後PCやスマホに並ぶ大きな市場が創出され、新しいサービスや体験が

拡がりと深化の両面で進んでいくことに期待です。

Apple Vision Proでできることや概要は他サイトやニュースで解説がすでにたくさんでていますので、当ブログでは第一弾的としてXR業界へ興味を持っていらっしゃる考えるテクノロジー関係者向けの視点で、Apple Visionに迫っていきたいとおもいます。

モニター

今回WWDC2023で発表されたヘッドセットは、

ビデオシースルータイプでした。

MRや空間センシングなどリッチな体験で市場創出を先導していたMicrosoftが

グラスシースルーだったため、この点については意外でした。

また、解像度が”4K以上の2300万画素”となっています。

つまり8K:3300万画素にはいかないまでのレベルということですね。

この数字や設計仕様の妥当感については、モニターのサイズ/画素密度/視野距離との関係性からくる人間の知覚視覚としての性能を見る必要があるため、別途整理して考察したいと思います。

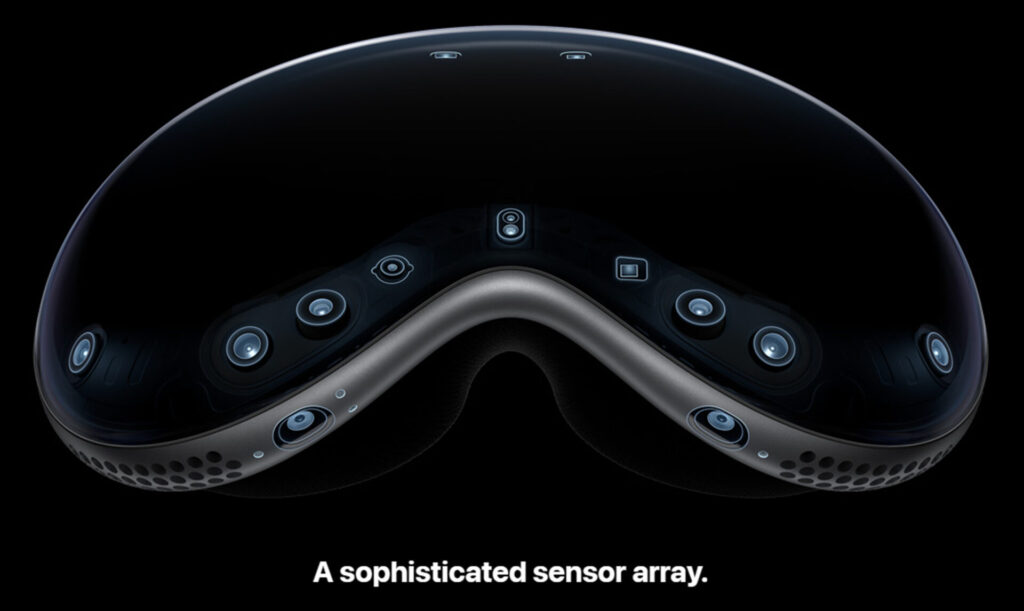

カメラセンサ

空間コンピューティングの肝であるカメラセンサについてです。

凄まじい数のカメラ/センサが搭載されています。

外部環境を映像としてキャプチャーするためのカメラ。

外部環境を3次元空間情報としてキャプチャーするためのDepthセンサ。

ジェスチャーを検出認識するためのセンサとしてのカメラ。

ここについても今ある情報をもとに今後詳細を分析したいとおもいます。

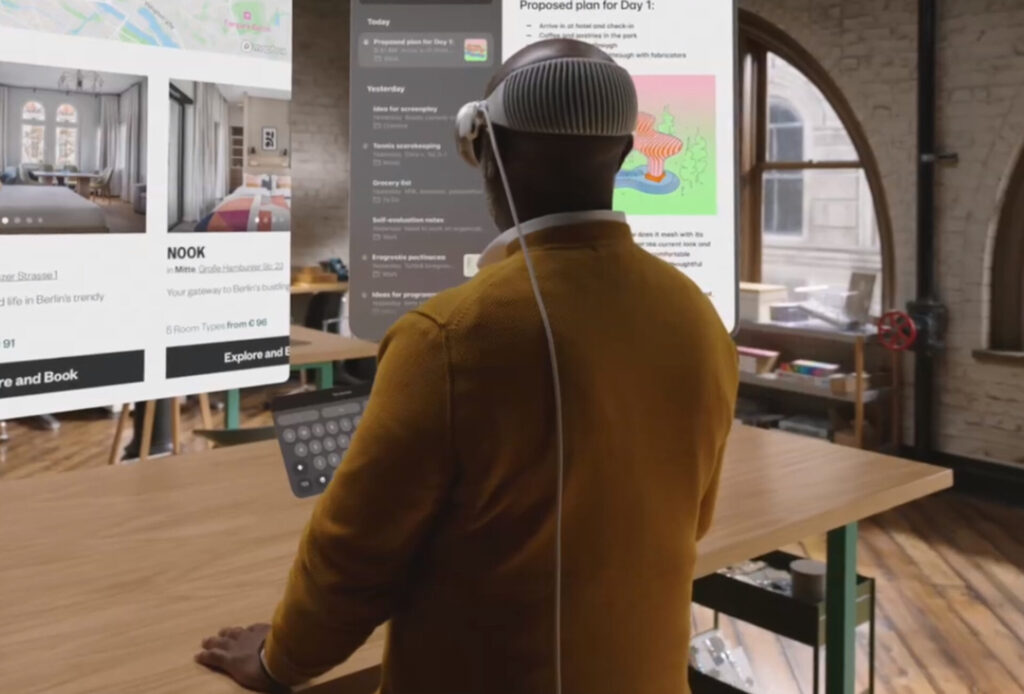

UI

よくあるVRヘッドセットでのリモコン使用とは違い、ジェスチャーで操作できます。

ここはさすがです。MicrosoftのHololensでもジェスチャー操作ができましたが、

“まだ違和感あり”の個人所感がありました。

タッチパネル操作に抱いていた先入観をiPhoneで刷新したAppleです。

ここは出来栄えに大いに期待したいですね。

また、アイトラッキングセンサが内蔵されているため眼の動きでの操作や

映像視聴時の補助が可能になっているのかもしれません。

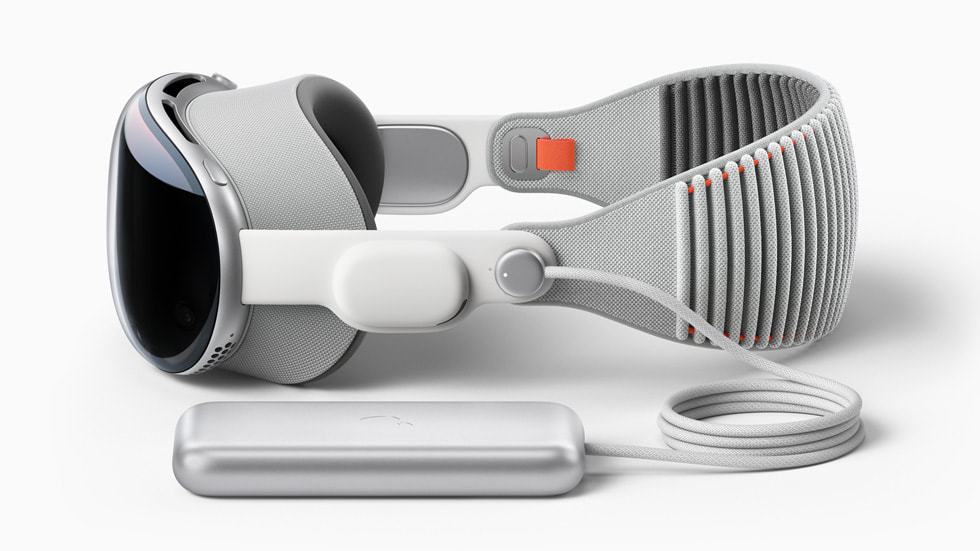

スタンドアロンか否か

Appleのポリシーというか、世間一般的に求められていたことですが、

コンピューティングや通信の側面においては、PCやスマホがなくとも

単体スタンドアロンで使用できます。

ただし、残念に思えた点はバッテリーは筐体に内包できず、

別途で用意されてケーブル接続が必要な点。

Appleらしからぬ点とはいえ、これについては仕方ないのかなと。

自動車並の膨大な画像センサー類や、それらを高速処理するための半導体ASICの

処理負荷を考えると言わずもがなです。

むしろ、膨大の数のセンサを搭載し、新規にASICを用意することで、

新しい体験の提供を市場に印象づけることに 振り切った設計となっていることに

潔さを感じました。